Cumplimiento de la Ley de Inteligencia Artificial (IA) de la UE

La Ley de IA de la UE es un marco regulatorio integral que clasifica los sistemas de IA por nivel de riesgo, impone requisitos estrictos a las aplicaciones de alto riesgo y prohíbe ciertos usos inaceptables para garantizar la seguridad, la transparencia y la protección de los derechos fundamentales.

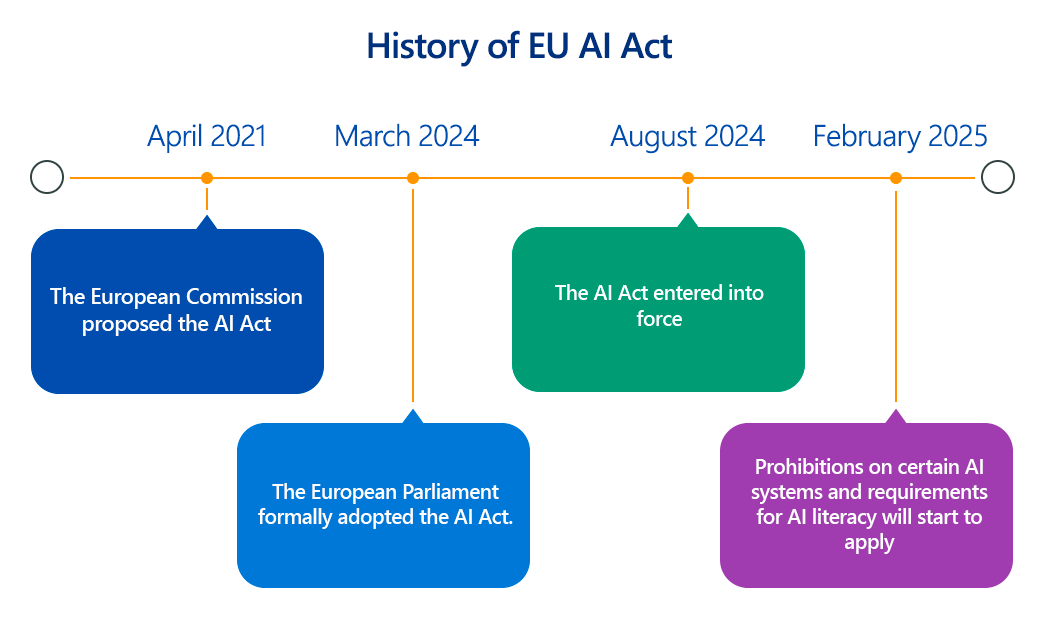

La Ley de Inteligencia Artificial de la Unión Europea (Ley de IA de la UE), que entró oficialmente en vigor en agosto de 2024 con fechas de aplicación escalonadas, marca un momento crucial en la regulación mundial de la inteligencia artificial.

Como el primer marco jurídico integral del mundo para la IA, busca fomentar el desarrollo y despliegue de IA confiable mediante un enfoque basado en riesgos, asegurando que los sistemas de IA sean seguros, transparentes, no discriminatorios y responsables.

Este artículo profundiza en las complejidades técnicas del Act, explorando sus aspectos clave de cumplimiento, la importancia de la adherencia y los pasos prácticos para las organizaciones.

Resumen de la Ley de IA de la UE

En esencia, la Ley de IA de la UE clasifica los sistemas de IA en cuatro niveles de riesgo distintos, cada uno con distintos grados de obligaciones regulatorias:

- Riesgo inaceptable: Estos sistemas de IA están prohibidos abiertamente en la UE debido a su potencial para representar una amenaza clara para los derechos fundamentales. Ejemplos incluyen sistemas de IA que emplean manipulación subliminal, puntuación social por parte de gobiernos, identificación biométrica en tiempo real a distancia en espacios públicos (con excepciones muy limitadas para la aplicación de la ley), y el raspado no dirigido de imágenes faciales para bases de datos.

- Alto riesgo: esta categoría abarca los sistemas de IA que pueden suponer un daño significativo para la salud, la seguridad o los derechos fundamentales. Estos sistemas están sujetos a requisitos estrictos antes de poder comercializarse o ponerse en servicio. Los sistemas de IA de alto riesgo incluyen los utilizados en infraestructuras críticas (por ejemplo, transporte, servicios públicos), educación (por ejemplo, acceso a la educación, calificación de exámenes), empleo (por ejemplo, clasificación de currículos, gestión de trabajadores), servicios públicos y privados esenciales (por ejemplo, calificación crediticia, despacho de emergencias), aplicación de la ley, migración y control de fronteras, y administración de justicia.

- Riesgo limitado: los sistemas de IA de esta categoría requieren obligaciones específicas de transparencia para garantizar que los usuarios sean conscientes de que están interactuando con una IA. Esto incluye chatbots y sistemas que generan o manipulan contenido (por ejemplo, deepfakes), que deben etiquetarse claramente como generados por IA.

- Riesgo mínimo o nulo: La gran mayoría de los sistemas de IA pertenecen a esta categoría, como filtros de spam con IA o videojuegos. Estos sistemas están en su mayoría exentos de regulación bajo la Ley, aunque se anima a los proveedores a adherirse a códigos de conducta voluntarios.

La Ley también introduce disposiciones específicas para los modelos de IA de uso general (GPAI), que son potentes modelos básicos capaces de realizar una amplia gama de tareas. Si un modelo GPAI presenta un «riesgo sistémico» (por ejemplo, un entrenamiento computacional que supere los 10²⁵ FLOPS o que la Comisión Europea considere de alto impacto), se somete a un escrutinio adicional, que incluye evaluaciones exhaustivas y la notificación de incidentes graves.

Aspectos clave de la conformidad con el Reglamento de IA de la UE

Para las organizaciones que desarrollan o despliegan sistemas de IA, especialmente los de alto riesgo, el cumplimiento implica un conjunto sólido de medidas técnicas y organizativas:

- Sistema de gestión de riesgos: Los proveedores de sistemas de IA de alto riesgo deben establecer, implementar, documentar y mantener un sistema integral de gestión de riesgos a lo largo del ciclo de vida del sistema de IA. Esto implica la identificación continua, evaluación y mitigación de los riesgos para la salud, la seguridad y los derechos fundamentales.

- Datos y gobernanza de datos: Un aspecto técnico crucial es garantizar la alta calidad de los datos utilizados para el entrenamiento, la validación y las pruebas de los sistemas de IA. Los conjuntos de datos deben ser relevantes, representativos, suficientemente completos y, en la medida de lo posible, libres de errores y sesgos. Las prácticas sólidas de gobernanza de datos son esenciales para lograr la calidad e integridad de los datos.

- Documentación técnica: Es obligatorio disponer de una documentación técnica exhaustiva y actualizada antes de poner en el mercado un sistema de IA de alto riesgo. Esta documentación (detallada en el anexo IV del Act) debe ser clara, completa y proporcionar toda la información necesaria para que las autoridades evalúen el cumplimiento. Incluye detalles sobre la arquitectura del sistema, el proceso de desarrollo, los datos utilizados, las medidas de seguridad y los resultados de las pruebas (precisión, robustez, ciberseguridad).

- Mantenimiento de registros y registro: Los sistemas de IA de alto riesgo deben registrar automáticamente los eventos durante toda su vida útil. Estos registros, junto con otra documentación relevante, deben conservarse durante al menos 10 años para garantizar la trazabilidad y la rendición de cuentas, especialmente en caso de errores o incidentes.

- Transparencia y suministro de información: Los proveedores deben garantizar la transparencia sobre el funcionamiento de sus sistemas de IA. Para los sistemas de alto riesgo, se debe proporcionar a los desplegadores (usuarios) información clara y adecuada sobre la finalidad, capacidades, limitaciones y riesgos potenciales del sistema, para que puedan utilizarlo de forma segura y eficaz. Para los sistemas de riesgo limitado, los usuarios deben ser informados explícitamente cuando interactúen con una IA.

- Supervisión humana: Los sistemas de IA de alto riesgo deben diseñarse para permitir una supervisión humana adecuada. Esto implica integrar mecanismos que aseguren una participación y control humano significativos, evitando que el sistema de IA supere o engañe a los tomadores de decisiones humanos. El diseño técnico debe facilitar la intervención humana, el monitoreo y la capacidad de interpretar las salidas del sistema.

- Precisión, robustez y ciberseguridad: Los sistemas de IA de alto riesgo deben diseñarse y desarrollarse para alcanzar un nivel adecuado de precisión, robustez y ciberseguridad. Esto incluye la capacidad de resistir errores, fallos y ataques maliciosos, garantizando un rendimiento fiable y seguro en condiciones normales y previsibles. Son críticas medidas técnicas como la validación de datos de entrada, la gestión de errores y las robustas medidas de ciberseguridad.

- Evaluación de la conformidad y marcado CE: antes de que un sistema de IA de alto riesgo pueda comercializarse, debe someterse a un procedimiento de evaluación de la conformidad, que a menudo incluye la intervención de un organismo notificado. Una vez superada la evaluación, el proveedor debe redactar una Declaración de Conformidad de la UE y colocar el marcado CE en el sistema de IA, indicando su conformidad con el Acta.

- Sistema de gestión de la calidad (SGC): Los proveedores de sistemas de IA de alto riesgo deben establecer y mantener un SGC documentado que garantice el cumplimiento a lo largo del ciclo de vida del sistema de IA, desde el diseño y el desarrollo hasta la implementación y la supervisión posterior al mercado.

¿Por qué es importante el cumplimiento del Reglamento de IA de la UE?

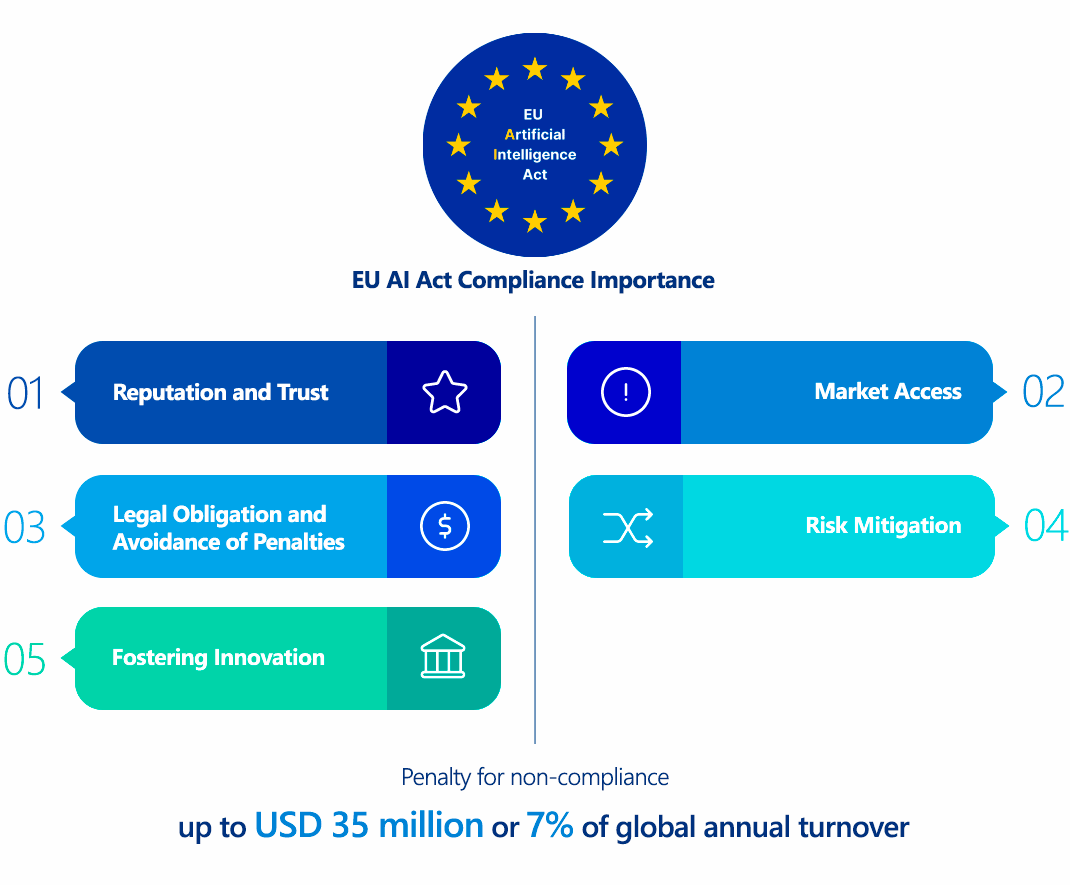

El cumplimiento de la Ley de IA de la UE es crucial por varias razones:

- Obligación legal y sanciones: La norma impone sanciones financieras significativas por incumplimiento, que pueden llegar hasta 35 millones de euros o el 7% de la facturación anual global de la empresa por violaciones de prácticas de IA prohibidas, y hasta 15 millones de euros o el 3% por otros incumplimientos. Proporcionar información incorrecta puede conllevar multas de hasta 7,5 millones de euros o el 1,5% de la facturación.

- Acceso al mercado: para las empresas que operan en el mercado de la UE o que desean entrar en él, el cumplimiento es un requisito previo. Los sistemas de IA no conformes pueden tener prohibida su puesta en el mercado o puesta en servicio en la UE.

- Reputación y confianza: el cumplimiento del Act demuestra un compromiso con una IA ética y responsable, lo que genera confianza entre usuarios, socios y el público. Esto puede suponer una ventaja competitiva significativa en un mundo cada vez más receloso de los posibles inconvenientes de la IA.

- Mitigación de riesgos: Los requisitos de la Ley, en particular para la IA de alto riesgo, están diseñados para mitigar los posibles daños asociados a la IA, como la discriminación, las violaciones de la privacidad o los fallos de seguridad. El cumplimiento proactivo reduce la probabilidad de incidentes, problemas legales y daños a la reputación.

- Fomento de la innovación: además de imponer regulaciones, la Ley también tiene como objetivo crear un marco que fomente la innovación responsable en materia de IA, proporcionando claridad jurídica y generando confianza pública en las tecnologías de IA.

¿Quién debe cumplir con la Ley de IA de la UE?

La Ley de IA de la UE tiene un amplio alcance extraterritorial, lo que significa que se aplica a cualquier organización que:

- Coloca sistemas de IA en el mercado o los pone en servicio en la UE, independientemente del lugar en el que esté establecida la organización.

- Se encuentra dentro de la UE y desarrolla, despliega o utiliza sistemas de IA.

- Proporciona sistemas de IA cuya salida se utiliza en la UE, incluso si el proveedor se encuentra fuera de la UE.

Esto incluye a proveedores (desarrolladores), implementadores (usuarios), importadores y distribuidores de sistemas de IA. Las obligaciones específicas varían según el papel que desempeñe una entidad y la clasificación de riesgo del sistema de IA.

Comparación entre el Reglamento AI de la UE y el RGPD

Si bien tanto la Ley de IA de la UE como el RGPD (Reglamento General de Protección de Datos) son reglamentos históricos de la UE destinados a proteger los derechos fundamentales en la era digital, tienen enfoques distintos:

| Característica | Reglamento de la UE sobre inteligencia artificial | RGPD |

|---|---|---|

| Enfoque principal | Regulación del desarrollo, la implementación y el uso de sistemas de inteligencia artificial, especialmente en cuanto a seguridad y derechos fundamentales. | Protegiendo datos personales y privacidad, otorgando a los individuos mayor control sobre su información personal. |

| Alcance | Se aplica a los sistemas de IA, independientemente de si procesan datos personales. Se centra en el sistema de IA y su impacto. | Se aplica al tratamiento de datos personales, independientemente de la tecnología utilizada. Se centra en los titulares y sus derechos. |

| Modelo de riesgo | Enfoque basado en el riesgo para los sistemas de IA (inaceptable, alto, limitado, mínimo). | Enfoque basado en el riesgo para el tratamiento de datos, centrado en la probabilidad y la gravedad de los riesgos para los derechos y libertades de las personas. |

| Aspectos técnicos | Se centra en los requisitos técnicos específicos de la IA: gestión de riesgos, calidad de los datos de entrenamiento para la IA, transparencia de los modelos de IA, supervisión humana, robustez, precisión y ciberseguridad de los sistemas de IA. | Céntrase en los principios de protección de datos: minimización de datos, limitación de finalidad, limitación de almacenamiento, exactitud, integridad y confidencialidad, y responsabilidad mediante medidas técnicas y organizativas (por ejemplo, cifrado, seudonimización, controles de acceso). |

| Solapamientos | Los sistemas de IA de alto riesgo suelen procesar datos personales, generando superposiciones significativas. El cumplimiento de los requisitos de gobernanza de datos de la Ley de IA (por ejemplo, mitigación de sesgos en los datos de entrenamiento) contribuirá con frecuencia al cumplimiento del RGPD. Asimismo, principios del RGPD como la minimización de datos y la exactitud son esenciales para el desarrollo ético de la IA. | La Ley de IA se basa implícitamente en el RGPD para los aspectos de privacidad de datos dentro de los sistemas de IA. Por ejemplo, la calidad de los conjuntos de datos para el entrenamiento de la IA debe cumplir con los principios del RGPD si se involucran datos personales. |

| Aplicación | Aplicación a través de las autoridades nacionales de supervisión y la Junta Europea de IA. | Aplicación a través de las autoridades nacionales de protección de datos (DPAs) y el Comité Europeo de Protección de Datos (EDPB). |

En esencia, la Ley de IA de la UE complementa al RGPD. Las organizaciones que manejan sistemas de IA que procesan datos personales deberán cumplir con ambas normativas, asegurando que su IA se ajuste a los requisitos técnicos y éticos específicos de la Ley de IA, al tiempo que garantizan los derechos fundamentales relacionados con la protección de datos consagrados en el RGPD.

¿Cómo garantizar el cumplimiento de la Ley de IA de la UE?

Lograr y mantener el cumplimiento de la Ley de IA de la UE es una tarea multifacética que requiere un enfoque sistemático:

- Inventario y clasificación del sistema de IA:

- Paso técnico: Realizar una auditoría exhaustiva de todos los sistemas de IA en uso o en desarrollo dentro de su organización.

- Detalles técnicos: para cada sistema, mapear meticulosamente su funcionalidad, finalidad prevista y cómo interactúa con los usuarios u otros sistemas. A continuación, aplicar el marco de clasificación de riesgos de la Ley de IA de la UE (inaceptable, alto, limitado, mínimo) a cada sistema de IA identificado. Esto suele implicar evaluaciones técnicas detalladas de las capacidades del modelo de IA, los datos que procesa y su impacto en las personas.

- Análisis de brechas y planificación de corrección:

- Paso técnico: Compare sus prácticas actuales de desarrollo y despliegue de IA con los requisitos específicos de la Ley de IA de la UE, especialmente para los sistemas de alto riesgo.

- Detalles técnicos: Identificar brechas técnicas y organizativas. Esto podría implicar evaluar sus pipelines de gobernanza de datos para la calidad de los datos de entrenamiento (por ejemplo, garantizar la representatividad, identificar y mitigar sesgos), revisar los mecanismos de explicabilidad del modelo, evaluar las interfaces human-in-the-loop y examinar los controles de ciberseguridad de la infraestructura de IA. Desarrollar una hoja de ruta detallada para abordar estas brechas.

- Implementar un marco sólido de gobernanza de la IA:

- Paso técnico: Establecer políticas, procedimientos y responsabilidades claros para todo el ciclo de vida de la IA.

- Detalles técnicos: Esto incluye definir roles para científicos de datos, ingenieros, equipos jurídicos y oficiales de cumplimiento. Implementar control de versiones para modelos de IA, protocolos seguros de manejo de datos para datos de entrenamiento e inferencia, y procesos robustos de gestión de cambios para actualizaciones del sistema de IA. Integrar la gobernanza de IA en los marcos existentes de gobernanza, riesgo y cumplimiento (GRC) empresarial. La norma ISO/IEC 42001 (Sistema de gestión de IA) puede proporcionar un enfoque estructurado.

- Documentación técnica y mantenimiento de registros:

- Paso técnico: Desarrollar y mantener documentación técnica completa según lo requerido por el Act.

- Detalles técnicos: Esto implica detallar la arquitectura del sistema de IA, la metodología de entrenamiento (incluidos los conjuntos de datos, los hiperparámetros y los algoritmos utilizados), los resultados de evaluación (precisión, robustez, métricas de equidad) y las medidas de ciberseguridad. Implemente sistemas de registro automatizados para registrar las actividades del sistema de IA a lo largo de su vida operativa, capturando eventos críticos, decisiones y métricas de rendimiento del sistema.

- Calidad de los datos y mitigación de sesgos

- Paso técnico: Priorizar la calidad de los datos y la equidad en el desarrollo de la IA.

- Detalle técnico: Implemente prácticas de gobernanza de datos para garantizar que los conjuntos de datos de entrenamiento, validación y prueba sean relevantes, representativos y minimicen el sesgo. Esto puede implicar el empleo de técnicas como el aumento de datos, la eliminación de sesgos adversarios y el análisis estadístico robusto para identificar y mitigar los sesgos en los datos y en las salidas del modelo de IA resultante. Las auditorías periódicas de los conjuntos de datos y del rendimiento del modelo en cuanto a equidad son cruciales.

- Supervisión humana y explicabilidad:

- Paso técnico: Diseñar sistemas de IA con mecanismos de supervisión humana.

- Detalles técnicos: Esto significa proporcionar interfaces claras para la intervención humana, la capacidad de anular decisiones de IA y herramientas para comprender el razonamiento de la IA (IA explicable - XAI). La documentación técnica debe explicar claramente las limitaciones de la IA, los posibles modos de fallo y cómo los humanos pueden supervisarla y controlarla de forma eficaz.

- Precisión, robustez y ciberseguridad por diseño:

- Paso técnico: Incorporar estos principios en el diseño y desarrollo del sistema de IA.

- Detalle técnico: Implementar metodologías de prueba rigurosas (por ejemplo, pruebas de estrés, pruebas adversarias) para garantizar la precisión del sistema de IA, su robustez frente a entradas inesperadas o ataques adversarios, y su resistencia a amenazas cibernéticas. Esto incluye la protección del modelo de IA en sí, su entorno de despliegue y las pipelines de datos.

- Evaluación de conformidad y proceso de marcado CE:

- Prepare y sométase a la evaluación de conformidad requerida.

- Detalle técnico: Esto implica compilar toda la documentación técnica necesaria, demostrar la efectividad del sistema de gestión de riesgos y probar el cumplimiento de todos los requisitos relevantes.63 Una vez evaluada la conformidad, aplicar la marca CE.

- Supervisión continua y vigilancia posterior a la comercialización:

- Paso técnico: Establecer sistemas para la supervisión continua de los sistemas de IA en implementación.

- Detalles técnicos: Esto incluye la supervisión continua del rendimiento, la detección de anomalías y mecanismos para informar e investigar incidentes graves o comportamientos inesperados. Implementar bucles de retroalimentación para actualizar y refinar los modelos de IA y su documentación asociada basándose en el rendimiento real.

Consecuencias del incumplimiento de la Ley de IA de la UE

Las sanciones por incumplimiento son importantes y se escalonan según la gravedad de la infracción:

- Infracciones de prácticas de IA prohibidas: hasta 35 millones de euros o el 7 % de los ingresos anuales totales a nivel mundial de la empresa en el ejercicio financiero anterior, lo que sea mayor.

- Incumplimiento de otras obligaciones (por ejemplo, requisitos de IA de alto riesgo): hasta 15 millones de euros o el 3 % de los ingresos anuales totales mundiales de la empresa en el ejercicio financiero anterior, el que sea mayor.

- Suministro de información incorrecta, incompleta o engañosa a los organismos notificados o a las autoridades nacionales competentes: hasta 7,5 millones de euros o el 1,5 % de los ingresos mundiales totales de la empresa durante el ejercicio financiero anterior, lo que resulte mayor.

Más allá de las sanciones económicas, el incumplimiento puede dar lugar a:

- Daño a la reputación: pérdida de confianza de los clientes, socios y el público.

- Exclusión del mercado: prohibición de poner en el mercado de la UE sistemas de IA no conformes.

- Acciones legales: demandas de personas o grupos perjudicados por sistemas de IA no conformes.

- Interrupciones operativas: las medidas correctivas pueden ser costosas y llevar mucho tiempo, lo que interrumpe las operaciones comerciales.

Cómo ayuda ImmuniWeb a cumplir con la Ley de IA de la UE

Aunque ImmuniWeb es conocido principalmente por su plataforma de ciberseguridad y pruebas de penetración basada en IA, sus capacidades pueden contribuir de manera significativa a los esfuerzos de cumplimiento de la Ley de IA de la UE por parte de una organización, especialmente en las áreas críticas de ciberseguridad, robustez, integridad de datos y soporte documental para sistemas de IA.

ImmuniWeb lleva a cabo pruebas de penetración profunda en API, descubriendo vulnerabilidades como endpoints inseguros, autenticación rota y fugas de datos, asegurando el cumplimiento con OWASP API Security Top 10.

Los escaneos automatizados impulsados por IA detectan configuraciones incorrectas, permisos excesivos y cifrado débil en las APIs REST, SOAP y GraphQL, proporcionando información útil para la corrección.

ImmuniWeb ofrece servicios de pruebas de penetración de aplicaciones con nuestro galardonado producto ImmuniWeb® On-Demand.

La premiada plataforma ImmuniWeb® AI para la gestión de la postura de seguridad de las aplicaciones (ASPM) ayuda a descubrir de manera agresiva y continua toda la huella digital de una organización, incluidas las aplicaciones web, APIs y aplicaciones móviles ocultas, desconocidas y olvidadas.

ImmuniWeb detecta y supervisa continuamente los activos de TI expuestos (aplicaciones web, API, servicios en la nube), lo que reduce los puntos ciegos y previene brechas mediante una calificación de riesgo en tiempo real.

ImmuniWeb ofrece servicios de pruebas de penetración automatizadas con nuestro galardonado producto ImmuniWeb® Continuous.

Simula ataques avanzados en entornos AWS, Azure y GCP para identificar malas configuraciones, roles IAM inseguros y almacenamiento expuesto, alineado con los benchmarks del CIS.

Automatiza la detección de malas configuraciones en la nube, brechas de cumplimiento (por ejemplo, PCI DSS, HIPAA) y TI en la sombra, y ofrece orientación para la corrección de una infraestructura en la nube resiliente.

Combina simulaciones de ataques impulsadas por inteligencia artificial con la experiencia humana para poner a prueba las defensas 24/7, imitando a adversarios del mundo real sin interrumpir las operaciones.

Ejecuta escenarios de ataque automatizados para validar los controles de seguridad, exponiendo las debilidades de las redes, las aplicaciones y los puntos finales antes de que los atacantes las exploiten.

Proporciona pentesting continuo y mejorado con IA para identificar nuevas vulnerabilidades tras la implementación, garantizando una mitigación proactiva de riesgos más allá de auditorías puntuales.

Prioritiza y remedia los riesgos en tiempo real correlacionando inteligencia de amenazas con vulnerabilidades en los activos, minimizando las ventanas de explotación.

Supervisa la Dark Web, los paste sites y los foros de hackers en busca de credenciales robadas, datos filtrados y amenazas dirigidas, lo que permite tomar acción preventiva.

La premiada plataforma ImmuniWeb® AI para la gestión del estado de seguridad de los datos ayuda a descubrir y supervisar continuamente los activos digitales de una organización expuestos a Internet, incluidas las aplicaciones web, las API, el almacenamiento en la nube y los servicios de red.

Analiza el Darknet en busca de datos comprometidos de empleados/clientes, propiedad intelectual y esquemas de fraude, alertando a las organizaciones sobre brechas.

Prueba aplicaciones iOS/Android en busca de almacenamiento de datos inseguro, riesgos de ingeniería inversa y fallos en las API, siguiendo las directrices OWASP Mobile Top 10.

Automatiza el análisis estático (SAST) y dinámico (DAST) de aplicaciones móviles para detectar vulnerabilidades como secretos codificados o configuraciones TLS débiles.

Identifica firewalls mal configurados, puertos abiertos y protocolos débiles en redes locales e híbridas, reforzando las defensas.

Ofrece pentesting escalable y basado en suscripción con informes detallados y seguimiento de la remediación para flujos de trabajo de seguridad ágiles.

Detecta y agiliza la eliminación de sitios de phishing que suplantan su marca, minimizando el daño reputacional y las pérdidas por fraude.

Simula amenazas persistentes avanzadas (APT) adaptadas a su sector, probando las capacidades de detección/respuesta frente a cadenas de ataque realistas.

Las pruebas manuales y automatizadas detectan fallos de SQLi, XSS y lógica empresarial en aplicaciones web, alineadas con el Top 10 de OWASP y las normas regulatorias.

Al aprovechar la avanzada plataforma de pruebas y gestión de seguridad de ImmuniWeb, las organizaciones pueden reforzar significativamente la postura de seguridad técnica de sus sistemas de IA, abordando directamente aspectos cruciales de los requisitos de cumplimiento de la Ley de IA de la UE, en particular para aplicaciones de alto riesgo. Aunque es solo una pieza del rompecabezas, un marco de ciberseguridad robusto proporcionado por herramientas como ImmuniWeb es indispensable para el cumplimiento integral de la Ley de IA.

Cumpla los requisitos normativos con la plataforma de IA ImmuniWeb®.

ImmuniWeb también puede ayudar a cumplir con otras leyes y normativas de protección de datos:

Europa

RGPD de la UE

EU DORA

NIS 2 de la UE

Ley de Ciberresiliencia de la UE

EU AI Act

Directiva ePrivacy de la UE

UK GDPR

FADP suiza

Circular FINMA 2023/1

América del Norte y del Sur

Oriente Medio y África

Ley de Protección de Datos Personales de Catar.

Ley de Protección de Datos Personales de Arabia Saudita

Marco de ciberseguridad de la Autoridad Monetaria de Arabia Saudí (1.0)

Ley de Protección de la Información Personal de Sudáfrica

UAE Information Assurance Regulation (1.1)

Ley de Protección de Datos Personales de los EAU

Asia-Pacífico

Australia Privacy Act

Ordenanza sobre la protección de datos personales de Hong Kong

Ley de Protección de Datos Personales Digitales de la India

Ley de Protección de la Información Personal de Japón

Ley de Protección de Datos Personales de Singapur