Conformité au règlement européen sur l'intelligence artificielle (IA)

La loi européenne sur l'IA est un cadre réglementaire complet qui classe les systèmes d'IA par niveau de risque, impose des exigences strictes aux applications à haut risque et interdit certaines utilisations inacceptables afin de garantir la sécurité, la transparence et la protection des droits fondamentaux.

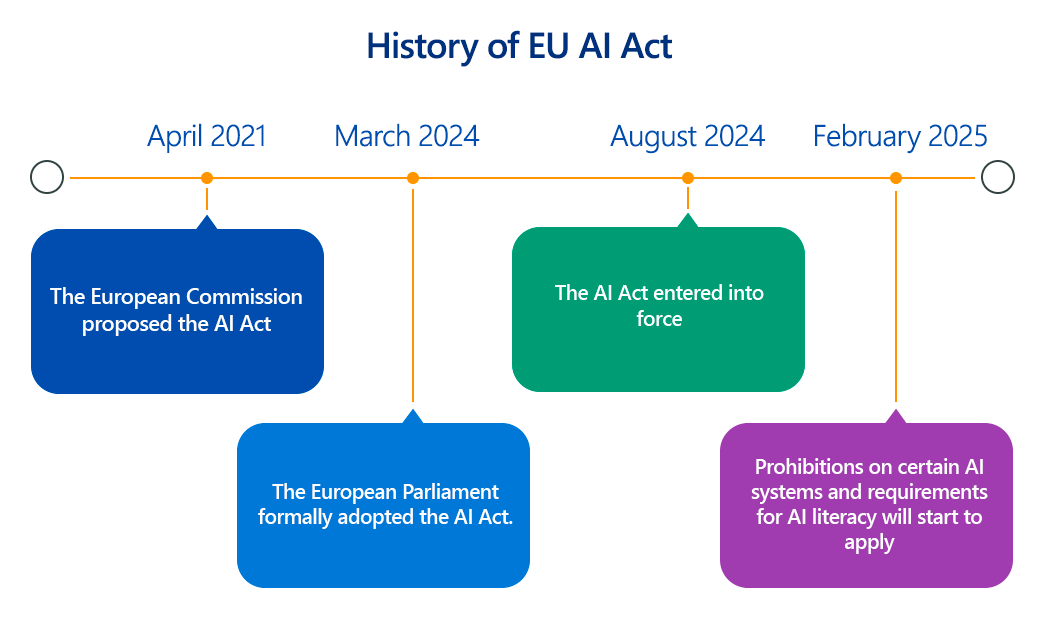

La loi de l'Union européenne sur l'intelligence artificielle (loi européenne sur l'IA), officiellement entrée en vigueur en août 2024 avec des dates d'application échelonnées, marque un tournant dans la réglementation mondiale de l'intelligence artificielle.

Premier cadre juridique complet au monde pour l'IA, il vise à favoriser le développement et le déploiement d'une IA fiable en introduisant une approche fondée sur les risques, garantissant que les systèmes d'IA sont sûrs, transparents, non discriminatoires et responsables.

Cet article explore les complexités techniques du Règlement, en examinant ses principaux aspects de conformité, l’importance de l’adhésion, et les étapes pratiques pour les organisations.

Aperçu de la loi européenne sur l'IA

Fondamentalement, le règlement européen sur l'IA classe les systèmes d'IA en quatre niveaux de risque distincts, chacun comportant des obligations réglementaires variables:

- Risque inacceptable: ces systèmes d'IA sont purement et simplement interdits dans l'UE en raison de leur potentiel à poser une menace claire aux droits fondamentaux. Exemples: les systèmes d'IA utilisant la manipulation subliminale, la notation sociale par les gouvernements, l'identification biométrique à distance en temps réel dans les espaces publics (avec des exceptions très limitées pour les forces de l'ordre), et le scraping non ciblé d'images faciales pour les bases de données.

- Risque élevé: cette catégorie englobe les systèmes d'IA pouvant porter une atteinte significative à la santé, à la sécurité ou aux droits fondamentaux. Ces systèmes sont soumis à des exigences strictes avant de pouvoir être mis sur le marché ou mis en service. Les systèmes d'IA à haut risque comprennent ceux utilisés dans les infrastructures critiques (par exemple, les transports, les services publics), l'éducation (par exemple, l'accès à l'éducation, la notation des examens), l'emploi (par exemple, le tri des CV, la gestion des travailleurs), les services publics et privés essentiels (par exemple, la notation de crédit, les interventions d'urgence), l'application de la loi, la migration et le contrôle des frontières, ainsi que l'administration de la justice.

- Risque limité: les systèmes d'IA de cette catégorie sont soumis à des obligations de transparence spécifiques afin de garantir que les utilisateurs sont conscients qu'ils interagissent avec une IA. Cela inclut les chatbots et les systèmes qui génèrent ou manipulent du contenu (par exemple, les deepfakes), qui doivent être clairement identifiés comme étant générés par une IA.

- Risque minimal ou nul: la grande majorité des systèmes d'IA entrent dans cette catégorie, tels que les filtres anti-spam ou les jeux vidéo basés sur l'IA. Ces systèmes sont largement non réglementés par la loi, bien que les fournisseurs soient encouragés à adhérer à des codes de conduite volontaires.

La loi introduit également des dispositions spécifiques pour les modèles d'IA à usage général (GPAI), qui sont des modèles de base puissants capables d'effectuer un large éventail de tâches. Si un modèle GPAI présente un «risque systémique» (par exemple, une formation computationnelle supérieure à 10²⁵ FLOPS ou jugée à fort impact par la Commission européenne), il fait l'objet d'un examen supplémentaire, comprenant des évaluations approfondies et la notification des incidents graves.

Aspects clés de la conformité à la loi européenne sur l'IA

Pour les organisations développant ou déployant des systèmes d'IA, en particulier ceux à haut risque, la conformité implique un ensemble robuste de mesures techniques et organisationnelles:

- Système de gestion des risques: les fournisseurs de systèmes d'IA à haut risque doivent établir, mettre en œuvre, documenter et maintenir un système complet de gestion des risques tout au long du cycle de vie du système d'IA. Cela implique une identification, une évaluation et une atténuation continues des risques pour la santé, la sécurité et les droits fondamentaux.

- Données et gouvernance des données: un aspect technique crucial consiste à garantir la haute qualité des données utilisées pour la formation, la validation et les tests des systèmes d'IA. Les ensembles de données doivent être pertinents, représentatifs, suffisamment complets et, dans la mesure du possible, exempts d'erreurs et de biais. Des pratiques solides en matière de gouvernance des données sont essentielles pour assurer la qualité et l'intégrité des données.

- Documentation technique: une documentation technique complète et à jour est obligatoire avant la mise sur le marché d’un système d’IA à haut risque. Cette documentation (détailée à l’annexe IV de l’Act) doit être claire, exhaustive et fournir toutes les informations nécessaires aux autorités pour évaluer la conformité. Elle comprend des détails sur l’architecture du système, le processus de développement, les données utilisées, les mesures de sécurité et les résultats des tests (précision, robustesse, cybersécurité).

- Tenue de registres et journalisation: les systèmes d'IA à haut risque doivent automatiquement enregistrer les événements tout au long de leur durée de vie. Ces journaux, ainsi que toute autre documentation pertinente, doivent être conservés pendant au moins 10 ans afin de garantir la traçabilité et la responsabilité, en particulier en cas d'erreurs ou d'incidents.

- Transparence et fourniture d'informations: les fournisseurs doivent garantir la transparence du fonctionnement de leurs systèmes d'IA. Pour les systèmes à haut risque, des informations claires et adéquates doivent être fournies aux utilisateurs sur l'objectif, les capacités, les limites et les risques potentiels du système, afin de leur permettre de l'utiliser de manière sûre et efficace. Pour les systèmes à risque limité, les utilisateurs doivent être explicitement informés lorsqu'ils interagissent avec une IA.

- Contrôle humain: les systèmes d’IA à haut risque doivent être conçus pour permettre un contrôle humain approprié. Cela implique l’intégration de mécanismes assurant une implication et un contrôle humains significatifs, empêchant le système d’IA de surclasser ou de tromper les décideurs humains. La conception technique doit faciliter l’intervention humaine, la surveillance et la capacité à interpréter les sorties du système.

- Précision, robustesse et cybersécurité: les systèmes d'IA à haut risque doivent être conçus et développés afin d'atteindre un niveau approprié de précision, de robustesse et de cybersécurité. Cela inclut la capacité à résister aux erreurs, aux défaillances et aux attaques malveillantes, garantissant ainsi des performances fiables et sécurisées dans des conditions normales et prévisibles. Des mesures techniques telles que la validation des données d'entrée, la gestion des erreurs et des mesures de cybersécurité robustes sont essentielles.

- Évaluation de la conformité et marquage CE: Avant qu’un système d’IA à haut risque puisse être mis sur le marché, il doit faire l’objet d’une procédure d’évaluation de la conformité, souvent impliquant un organisme tiers notifié. Une fois l’évaluation réussie, le fournisseur doit rédiger une Déclaration de conformité UE et apposer le marquage CE sur le système d’IA, indiquant sa conformité avec l’Acte.

- Système de gestion de la qualité (SGQ): les fournisseurs de systèmes d'IA à haut risque doivent mettre en place et maintenir un SGQ documenté qui garantit la conformité tout au long du cycle de vie du système d'IA, de la conception et du développement au déploiement et à la surveillance après la mise sur le marché.

Pourquoi la conformité au règlement européen sur l’IA est-elle importante?

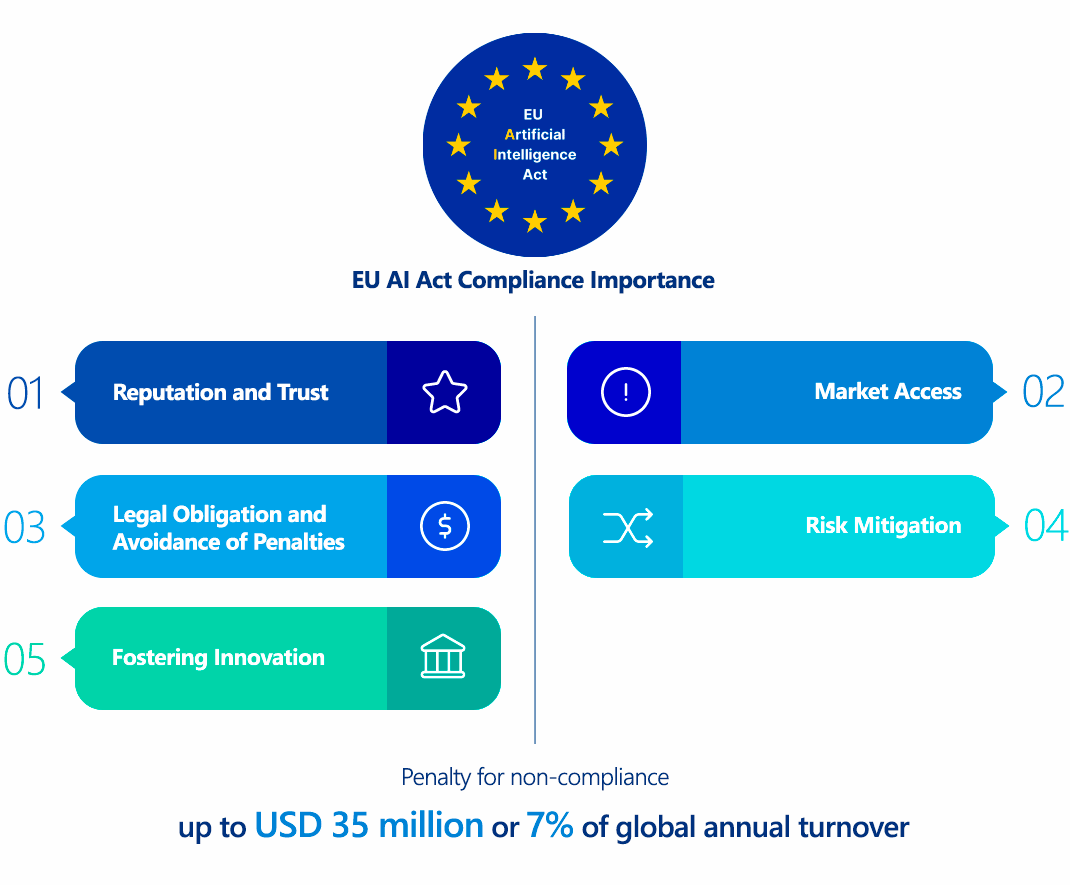

La conformité à l'EU AI Act est cruciale pour plusieurs raisons:

- Obligations légales et sanctions: l'acte prévoit des sanctions financières importantes en cas de non-conformité, allant jusqu'à 35 millions d'euros ou 7 % du chiffre d'affaires mondial annuel d'une entreprise pour les infractions aux pratiques d'IA interdites, et 15 millions d'euros ou 3 % pour les autres cas de non-conformité. Fournir des informations inexactes peut entraîner des amendes pouvant s'élever jusqu'à 7,5 millions d'euros ou 1,5 % du chiffre d'affaires.

- Accès au marché: pour les entreprises opérant dans le marché de l'UE ou souhaitant y pénétrer, la conformité est une condition préalable. Les systèmes d'IA non conformes peuvent être interdits de mise sur le marché ou de mise en service dans l'UE.

- Réputation et confiance: le respect de la loi témoigne d’un engagement en faveur d’une IA éthique et responsable, renforçant ainsi la confiance des utilisateurs, partenaires et du public. Cela peut constituer un avantage concurrentiel significatif dans un monde de plus en plus méfiant à l’égard des inconvénients potentiels de l’IA.

- Atténuation des risques: les exigences de la loi, en particulier pour l’IA à haut risque, sont conçues pour atténuer les dommages potentiels associés à l’IA, tels que la discrimination, les violations de la vie privée ou les défaillances en matière de sécurité. Une conformité proactive réduit la probabilité d’incidents, de litiges juridiques et de préjudice réputationnel.

- Favoriser l'innovation: tout en imposant des réglementations, l'Acte vise également à créer un cadre qui encourage l'innovation responsable en IA en fournissant une clarté juridique et en renforçant la confiance du public dans les technologies d'IA.

Qui doit se conformer à la loi européenne sur l’IA?

La loi européenne sur l'IA a une large portée extraterritoriale, ce qui signifie qu'elle s'applique à toute organisation qui:

- Mise sur le marché ou mise en service de systèmes d'IA dans l'UE, quel que soit le lieu d'établissement de l'organisation.

- Est situé dans l'UE et développe, déploie ou utilise des systèmes d'IA.

- Fournit des systèmes d'IA dont les résultats sont utilisés dans l'UE, même si le fournisseur est situé hors de l'UE.

Cela inclut les fournisseurs (développeurs), les déployeurs (utilisateurs), les importateurs et les distributeurs de systèmes d’IA. Les obligations spécifiques varient selon le rôle joué par l’entité et la classification du risque du système d’IA.

Comparaison entre la loi européenne sur l’IA et le RGPD

Si la loi européenne sur l'IA et le RGPD (règlement général sur la protection des données) sont tous deux des réglementations européennes historiques visant à protéger les droits fondamentaux à l'ère numérique, elles ont des objectifs distincts:

| Caractéristique | Loi européenne sur l’IA | RGPD |

|---|---|---|

| Objectif principal | Réglementation du développement, du déploiement et de l'utilisation des systèmes d'intelligence artificielle, en particulier en ce qui concerne la sécurité et les droits fondamentaux. | Protéger les données à caractère personnel et la vie privée, donner aux individus plus de contrôle sur leurs informations personnelles. |

| Champ d'application | S’applique aux systèmes d’IA, qu’ils traitent ou non des données à caractère personnel. Se concentre sur le système d’IA lui-même et son impact. | S'applique au traitement des données à caractère personnel, quelle que soit la technologie utilisée. Se concentre sur les sujets de données et leurs droits. |

| Modèle de risque | Approche fondée sur les risques des systèmes d'IA (inacceptable, élevé, limité, minimal). | Approche du traitement des données fondée sur les risques, axée sur la probabilité et la gravité des risques pour les droits et libertés des personnes. |

| Aspects techniques | Se concentre sur les exigences techniques spécifiques à l'IA: gestion des risques, qualité des données pour l'entraînement de l'IA, transparence des modèles d'IA, supervision humaine, robustesse, précision, cybersécurité des systèmes d'IA. | Se concentre sur les principes de protection des données: minimisation des données, limitation de la finalité, limitation de la conservation, exactitude, intégrité et confidentialité, et responsabilité grâce à des mesures techniques et organisationnelles (par exemple, cryptage, pseudonymisation, contrôles d'accès). |

| Overlaps | Les systèmes d'IA à haut risque traitent souvent des données à caractère personnel, ce qui crée des chevauchements importants. La conformité aux exigences de la loi sur l'IA en matière de gouvernance des données (par exemple, l'atténuation des biais dans les données d'entraînement) contribuera souvent à la conformité au RGPD. De même, les principes du RGPD tels que la minimisation des données et leur exactitude sont essentiels pour un développement éthique de l'IA. | La loi sur l'IA s'appuie implicitement sur le RGPD pour les aspects liés à la confidentialité des données dans les systèmes d'IA. Par exemple, la qualité des ensembles de données utilisés pour la formation de l'IA doit également être conforme aux principes du RGPD si des données à caractère personnel sont concernées. |

| Application | Application par les autorités nationales de contrôle et le Conseil européen de l'intelligence artificielle. | Application par les autorités nationales de protection des données (DPAs) et le Comité européen de la protection des données (EDPB). |

En substance, la loi européenne sur l'IA complète le RGPD. Les organisations utilisant des systèmes d'IA traitant des données à caractère personnel devront se conformer aux deux réglementations, en veillant à ce que leur IA respecte les exigences techniques et éthiques spécifiques de la loi sur l'IA tout en respectant les droits fondamentaux liés à la protection des données tels qu'ils sont consacrés dans le RGPD.

Comment garantir la conformité à la loi européenne sur l'IA?

La mise en conformité et le maintien de la conformité avec l’acte européen sur l’IA est une démarche multiforme qui nécessite une approche systématique:

- Inventaire et classification des systèmes d'IA:

- Étape technique: Réalisez un audit complet de tous les systèmes d'IA utilisés ou en cours de développement au sein de votre organisation.

- Détails techniques: pour chaque système, cartographier méticuleusement ses fonctionnalités, son objectif et la manière dont il interagit avec les utilisateurs ou d'autres systèmes. Appliquer ensuite le cadre de classification des risques de l'Acte européen sur l'IA (inacceptable, élevé, limité, minimal) à chaque système d'IA identifié. Cela implique souvent des évaluations techniques détaillées des capacités du modèle d'IA, des données qu'il traite et de son impact sur les individus.

- Analyse des écarts et planification des mesures correctives:

- Étape technique: comparez vos pratiques actuelles de développement et de déploiement de l’IA aux exigences spécifiques du règlement européen sur l’IA, en particulier pour les systèmes à haut risque.

- Détails techniques: identifier les lacunes techniques et organisationnelles. Cela peut impliquer d’évaluer vos pipelines de gouvernance des données pour la qualité des données d’entraînement (par exemple, garantir la représentativité, identifier et atténuer les biais), d’examiner les mécanismes d’explicabilité des modèles, d’évaluer les interfaces humaines dans la boucle et d’examiner minutieusement les contrôles de cybersécurité pour l’infrastructure IA. Élaborer une feuille de route détaillée pour combler ces lacunes.

- Mettre en œuvre un cadre de gouvernance robuste pour l'IA:

- Étape technique: établir des politiques, procédures et responsabilités claires pour l’ensemble du cycle de vie de l’IA.

- Détails techniques: cela inclut la définition des rôles des data scientists, des ingénieurs, des équipes juridiques et des responsables de la conformité. Mettre en œuvre un contrôle de version pour les modèles d’IA, des protocoles sécurisés de gestion des données pour les données d’entraînement et d’inférence, et des processus robustes de gestion des changements pour les mises à jour des systèmes d’IA. Intégrer la gouvernance de l’IA dans les cadres existants de gouvernance, de risque et de conformité (GRC) de l’entreprise. La norme ISO/IEC 42001 (système de gestion de l’IA) peut fournir une approche structurée.

- Documentation technique et tenue de registres:

- Étape technique: développer et maintenir une documentation technique complète, comme l'exige l'Acte.

- Détails techniques: cela implique de détailler l'architecture du système d'IA, la méthodologie de formation (y compris les ensembles de données, les hyperparamètres et les algorithmes utilisés), les résultats d'évaluation (précision, robustesse, mesures d'équité) et les mesures de cybersécurité. Mettre en œuvre des systèmes de journalisation automatisés pour enregistrer les activités du système d'IA tout au long de sa durée de vie opérationnelle, en capturant les événements critiques, les décisions et les indicateurs de performance du système.

- Qualité des données et atténuation des biais:

- Étape technique: Prioriser la qualité et l’équité des données dans le développement de l’IA.

- Détails techniques: Mettez en œuvre des pratiques de gouvernance des données afin de garantir que les ensembles de données utilisés pour la formation, la validation et les tests sont pertinents, représentatifs et minimisent les biais. Cela peut impliquer l’utilisation de techniques telles que l’augmentation des données, le débiaisage adversarial et l’analyse statistique robuste afin d’identifier et d’atténuer les biais dans les données et les sorties du modèle d’IA résultant. Des audits réguliers des ensembles de données et des performances des modèles en matière d’équité sont essentiels.

- Supervision humaine et explicabilité:

- Étape technique: concevoir des systèmes d'IA avec des mécanismes de supervision humaine.

- Détails techniques: cela signifie fournir des interfaces claires pour l’intervention humaine, la possibilité d’annuler les décisions de l’IA et des outils permettant de comprendre le raisonnement de l’IA (IA explicable - XAI). La documentation technique doit expliquer clairement les limites de l’IA, les modes de défaillance potentiels et la manière dont les humains peuvent surveiller et contrôler efficacement l’IA.

- Exactitude, robustesse et cybersécurité dès la conception:

- Étape technique: intégrer ces principes dans la conception et le développement du système d'IA.

- Détails techniques: Mettre en œuvre des méthodologies de test rigoureuses (par exemple, tests de charge, tests adverses) pour garantir la précision du système d'IA, sa robustesse face à des entrées inattendues ou des attaques adverses, et sa résilience face aux cybermenaces. Cela comprend la sécurisation du modèle d'IA lui-même, de son environnement de déploiement et des pipelines de données.

- Évaluation de la conformité et processus de marquage CE:

- Étape technique: pour les systèmes d'IA à haut risque, préparez-vous et passez l'évaluation de conformité requise.

- Détails techniques: cela implique de compiler toute la documentation technique nécessaire, de démontrer l’efficacité du système de gestion des risques et de prouver le respect de toutes les exigences pertinentes.63 Une fois la conformité évaluée, apposer le marquage CE.

- Surveillance continue et surveillance post-marché:

- Étape technique: mettre en place des systèmes de surveillance continue des systèmes d'IA en production.

- Détails techniques: Cela comprend la surveillance continue des performances, la détection des anomalies et les mécanismes de signalement et d’enquête sur les incidents graves ou les comportements inattendus. Mettez en place des boucles de rétroaction pour mettre à jour et affiner les modèles d’IA et la documentation associée en fonction des performances réelles.

Conséquences de la non-conformité au règlement européen sur l'intelligence artificielle

Les sanctions en cas de non-conformité sont lourdes et échelonnées en fonction de la gravité de l'infraction:

- Violations des pratiques interdites en matière d'IA: jusqu'à 35 millions d'euros ou 7 % du chiffre d'affaires mondial annuel total de l'entreprise pour l'exercice financier précédent, le plus élevé des deux.

- Non-respect d'autres obligations (par exemple, exigences en matière d'IA à haut risque): jusqu'à 15 millions d'euros ou 3 % du chiffre d'affaires mondial annuel total de l'entreprise pour l'exercice financier précédent, le plus élevé des deux.

- Fourniture d'informations incorrectes, incomplètes ou trompeuses aux organismes notifiés ou aux autorités nationales compétentes: jusqu'à 7,5 millions d'euros ou 1,5 % du chiffre d'affaires mondial total de l'entreprise pour l'exercice financier précédent, le plus élevé des deux.

Au-delà des sanctions financières, la non-conformité peut entraîner:

- Atteinte à la réputation: perte de confiance des clients, partenaires et du public.

- Exclusion du marché: interdiction de mettre sur le marché des systèmes d'IA non conformes.

- Action en justice: poursuites judiciaires intentées par des personnes ou des groupes lésés par des systèmes d'IA non conformes.

- Perturbations opérationnelles: les efforts de remédiation peuvent être coûteux et chronophages, perturbant ainsi les opérations métier.

Comment ImmuniWeb aide à se conformer à l'Acte européen sur l'IA

Si ImmuniWeb est principalement connu pour sa plateforme de cybersécurité et de tests de pénétration basée sur l'IA, ses capacités peuvent contribuer de manière significative aux efforts de conformité d'une organisation à l'EU AI Act, en particulier dans les domaines critiques de la cybersécurité, la robustesse, l'intégrité des données et le support documentaire pour les systèmes d'IA.

ImmuniWeb effectue des tests de pénétration approfondis des API, mettant au jour des vulnérabilités telles que des endpoints non sécurisés, des authentifications cassées et des fuites de données, garantissant ainsi la conformité avec l’OWASP API Security Top 10.

Des analyses automatisées basées sur l'IA détectent les erreurs de configuration, les autorisations excessives et le chiffrement faible dans les API REST, SOAP et GraphQL, fournissant des conseils d'action pour remédier.

ImmuniWeb fournit des services de tests de pénétration applicatifs grâce à notre produit primé ImmuniWeb® On-Demand.

La plateforme IA ImmuniWeb® primée pour la gestion de la posture de sécurité des applications (ASPM) permet de découvrir de manière proactive et continue l'ensemble de l'empreinte numérique d'une organisation, y compris les applications web, les API et les applications mobiles cachées, inconnues et oubliées.

ImmuniWeb détecte et surveille en permanence les actifs informatiques exposés (applications Web, API, services cloud), réduisant les angles morts et prévenant les violations grâce à une évaluation des risques en temps réel.

ImmuniWeb fournit des services de tests d'intrusion automatisés avec notre produit primé ImmuniWeb® Continuous.

Simule des attaques avancées sur les environnements AWS, Azure et GCP afin d'identifier les mauvaises configurations, les rôles IAM non sécurisés et les stockages exposés, conformément aux benchmarks CIS.

Automatise la détection des erreurs de configuration du cloud, des lacunes en matière de conformité (par exemple, PCI DSS, HIPAA) et du shadow IT, et propose des conseils de correction pour une infrastructure cloud résiliente.

Combine des simulations d'attaques basées sur l'IA et l'expertise humaine pour tester les défenses 24/7, en imitant des adversaires réels sans perturber les opérations.

Exécute des scénarios d'attaques automatisées pour valider les contrôles de sécurité, exposant les faiblesses des réseaux, des applications et des terminaux avant que les attaquants ne les exploitent.

Fournit un pentesting continu, renforcé par l’IA, pour identifier les nouvelles vulnérabilités après déploiement, garantissant une atténuation proactive des risques au-delà des audits ponctuels.

Hiérarchise et corrige les risques en temps réel en corrélant les informations sur les menaces avec les vulnérabilités des actifs, minimisant les fenêtres d'exploitation.

Surveille le Dark Web, les sites de paste et les forums de hackers à la recherche d'identifiants volés, de données divulguées et de menaces ciblées, permettant ainsi des mesures préemptives.

La plateforme IA ImmuniWeb® primée pour la gestion de la posture de sécurité des données permet de détecter et de surveiller en continu les actifs numériques exposés à Internet, y compris les applications Web, les API, le stockage dans le cloud et les services réseau.

Analyse les marchés du Darknet à la recherche de données compromises sur les employés/clients, de propriété intellectuelle et de schémas frauduleux, et alerte les organisations en cas de violation.

Automatise l'analyse statique (SAST) et dynamique (DAST) des applications mobiles afin de détecter les vulnérabilités comme les secrets codés en dur ou les configurations TLS faibles.

Identifie les pare-feu mal configurés, les ports ouverts et les protocoles faibles sur les réseaux locaux et hybrides, renforçant les défenses.

Fournit des pentesting évolutifs, basés sur un abonnement, avec des rapports détaillés et un suivi des remédiations pour des workflows de sécurité agiles.

Détecte et accélère la suppression des sites de phishing usurpant votre marque, minimisant les atteintes à votre réputation et les pertes dues à la fraude.

Évalue la posture de sécurité des fournisseurs (par exemple, API exposées, logiciels périmés) afin de prévenir les attaques de la chaîne d'approvisionnement et d'assurer la conformité.

Simule des menaces persistantes avancées (APT) adaptées à votre secteur, testant les capacités de détection et de réponse face à des chaînes d’attaque réalistes.

Des tests manuels et automatisés permettent de détecter les failles SQLi, XSS et de logique métier dans les applications web, conformément au Top 10 OWASP et aux normes réglementaires.

Effectue des scans DAST continus pour détecter les vulnérabilités en temps réel, en s'intégrant aux pipelines CI/CD pour une efficacité DevSecOps.

En tirant parti de la plateforme avancée de test et de gestion de la sécurité d'ImmuniWeb, les organisations peuvent renforcer considérablement la posture technique de sécurité de leurs systèmes d'IA, en répondant directement aux aspects cruciaux des exigences de conformité de l'EU AI Act, en particulier pour les applications à haut risque. Bien qu'il ne s'agisse que d'une pièce du puzzle, un cadre de cybersécurité robuste fourni par des outils tels qu'ImmuniWeb est indispensable pour une conformité complète à l'EU AI Act.

Répondez aux exigences réglementaires grâce à la plateforme IA ImmuniWeb®.

ImmuniWeb peut également aider à se conformer à d'autres lois et réglementations en matière de protection des données:

Europe

RGPD de l'UE

DORA de l'UE

NIS 2 de l'UE

EU Cyber Resilience Act

Règlement européen sur l’intelligence artificielle

EU ePrivacy Directive

UK GDPR

FADP suisse

Circulaire FINMA 2023/1

Amérique du Nord et du Sud

Loi brésilienne sur la protection des données LGPD

CCPA Californie

Canada PIPEDA

Règlement de cybersécurité du DFS de New York

Loi SHIELD de New York

Règle de protection des données de la FTC américaine

HIPAA États-Unis

Moyen-Orient et Afrique

Loi sur la protection des données personnelles du Qatar

Loi sur la protection des données personnelles en Arabie saoudite

Saudi Arabian Monetary Authority Cyber Security Framework (1.0)

Afrique du Sud Loi sur la protection des informations personnelles

Règlement des Émirats arabes unis sur la sécurité de l'information (1.1)

Loi des Émirats arabes unis sur la protection des données personnelles

Asie-Pacifique

Loi australienne sur la protection des données personnelles

Ordonnance sur la protection des données personnelles de Hong Kong

Loi indienne sur la protection des données personnelles

Loi japonaise sur la protection des informations personnelles

Loi sur la protection des données personnelles de Singapour